Kim jest „cyfrowy agitator”? Nowy typ influencera ekstremistycznego

Od klasycznego influencera do propagandysty

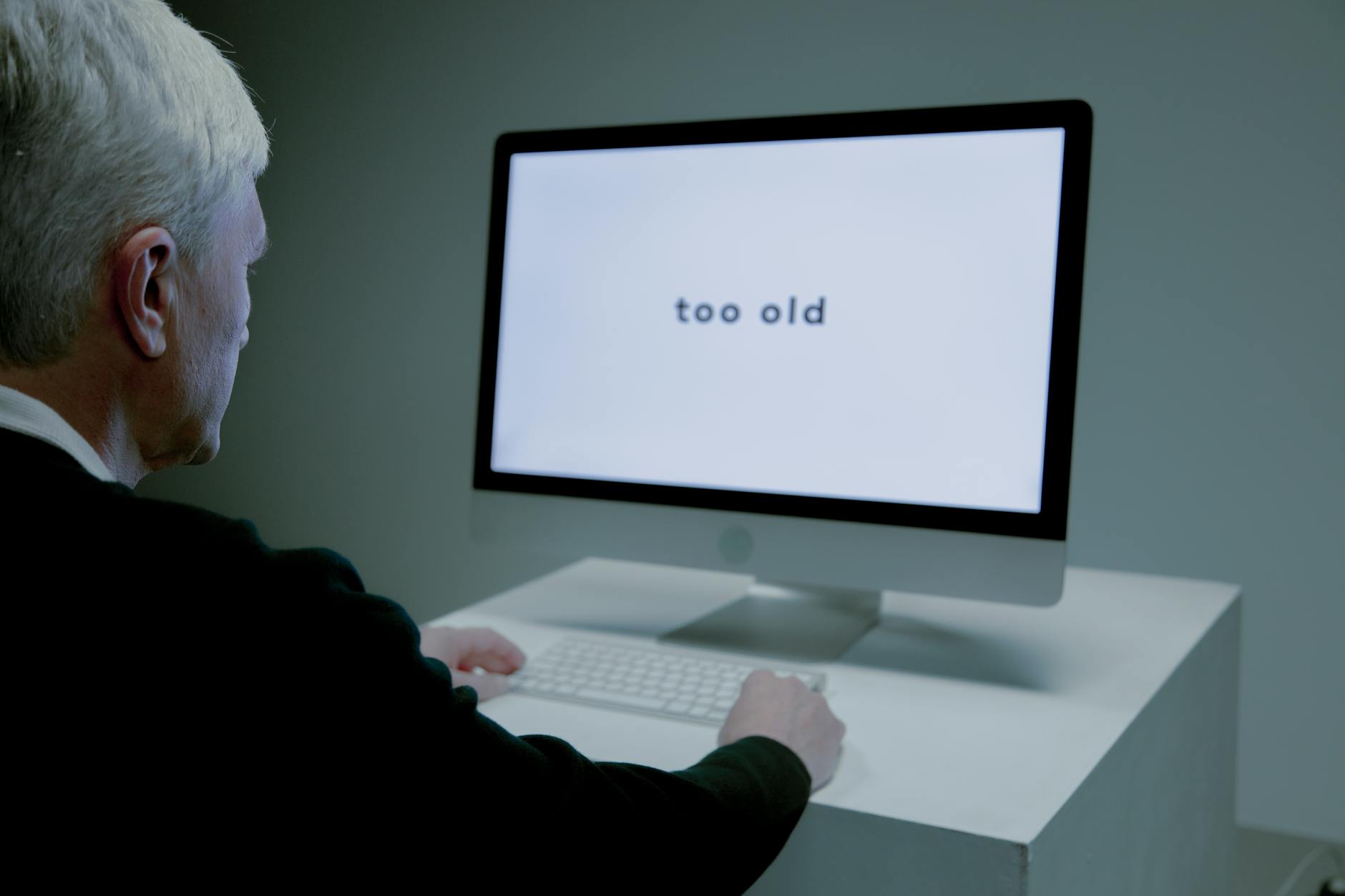

Cyfrowy agitator to influencer, który wykorzystuje swoje zasięgi i zaufanie odbiorców do systematycznego promowania treści ekstremistycznych – politycznych, religijnych, światopoglądowych – zwykle w sposób opakowany, częściowo zawoalowany i rozciągnięty w czasie. Nie zawsze zaczyna jako propagandysta. Często wychodzi z typowych kategorii: lifestyle, gry, fitness, coaching, komentarz społeczny. Ekstremizm pojawia się stopniowo, jako „dodatek”, który z czasem zaczyna dominować.

Granica między opinią a agitacją przebiega nie po samym tonie wypowiedzi, ale po jej funkcji. Gdy twórca:

- regularnie wskazuje jedną grupę jako źródło zła, zagrożenia lub „choroby społeczeństwa”,

- powtarza uprzedzenia i dehumanizujące stereotypy,

- wzywa do izolowania, wypychania z życia publicznego, a czasem przemocy wobec „wrogów”,

- wspiera lub usprawiedliwia działania organizacji ekstremistycznych,

– wchodzi na obszar agitacji, nawet jeśli unika dosłownych deklaracji. Istotny staje się rezultat komunikacji: czy odbiorcy po zetknięciu z twórcą są bardziej otwarci na skrajną ideologię, czy bardziej odporni na nienawiść.

Jawna propaganda a „miękka” normalizacja ekstremizmu

Tradycyjny obraz propagandy to patetyczne przemówienia, flagi, mobilizacyjne hasła. W ekosystemie influencerów rzadko wygląda to tak wprost. Zdecydowanie częściej działa tzw. soft propaganda – rozsiana pośród rozrywki i codzienności. Twórca nie mówi: „dołącz do organizacji X”, lecz raczej:

- powtarza „niewinne” żarty uderzające w mniejszości,

- bagatelizuje przemoc jako „reakcję na prowokację”,

- przedstawia ekstremalne opinie jako „zdrowy rozsądek, którego nie wolno mieć w tych czasach”,

- normalizuje symbole, slogany, gesty kojarzone z radykalnymi ruchami.

Miękka normalizacja ekstremizmu polega na tym, że radykalne treści stają się jednym z wielu elementów scenografii vloga czy streamu. Pojawiają się na koszulce, plakacie w tle, w memie wyświetlonym „dla śmiechu”. Odbiorca przyzwyczaja się do nich, zanim zrozumie, co oznaczają. Gdy później spotka narrację bardziej jawną, nie odbiera jej jako obcej, ale jako „bliższą” i „oswojoną”.

Typy cyfrowych agitatorów: lider, memiczny prowokator, „bohater antysystemu”

Cyfrowi agitatorzy nie są jednolitą grupą. W praktyce najczęściej pojawiają się trzy rozpoznawalne role:

Lider opinii o wyraźnej agendzie

To twórca, który otwarcie prezentuje poglądy skrajne lub bardzo bliskie ekstremizmowi. Prowadzi długie analizy, podcasty, live’y, nagrywa „komentarze polityczne”. Buduje relację mistrz–uczeń z odbiorcami: tłumaczy świat, demaskuje „ukryte mechanizmy”, prezentuje się jako ktoś, kto „przejrzał system na wylot”. Taki lider rzadko używa humoru jako głównego narzędzia – stawia raczej na pozór powagi i eksperckości.

Memiczy prowokator

Drugi typ to „śmieszek”, który działa memami, krótkimi klipami, ciętymi ripostami. Oficjalnie „tylko żartuje”, jednak jego memy powielają wizerunek wroga – np. demonizowanej grupy etnicznej, „zdrajców narodu”, „degeneratów”. Ten format jest szczególnie skuteczny wśród młodszych odbiorców: ironia daje osłonę przed krytyką („przecież to humor”), a jednocześnie stabilnie przesuwa normy tego, co wolno powiedzieć publicznie.

„Bohater antysystemu”

To postać budująca wizerunek ofiary systemu: algorytmów, mediów głównego nurtu, „kultury anulowania”. Twórca stale opowiada o blokadach, cenzurze, demonetyzacji, rzekomej nagonce. Ekstremalna treść jest tu przedstawiana jako wyraz „odwagi mówienia prawdy”, a każdy sprzeciw – jako dowód spisku przeciwko niemu i jego społeczności. Taki profil doskonale mobilizuje odbiorców do walki w jego obronie, także poza siecią.

Jak influencerzy stają się kanałem dla treści ekstremistycznych

Świadomy ideolog a „użyteczny idiota”

Nie każdy influencer szerzący ekstremistyczne narracje robi to w pełni świadomie. Można wyróżnić dwie skrajne postawy:

- Świadomy agitator – zna ideologię, świadomie się z nią identyfikuje, często ma kontakt z organizacjami ekstremistycznymi, planuje przekaz i narracje.

- „Użyteczny idiota” – nie rozumie do końca konsekwencji, powiela memy, slogany i symbole, bo „dobrze żrą”, przyciągają uwagę, budzą emocje. Dla radykałów jest cennym nośnikiem, nawet jeśli sam nie czuje się ekstremistą.

Granicę między tymi rolami wyznacza świadomość skutków. Jeśli twórca po zwróceniu uwagi podwaja stawkę, bagatelizuje przemoc, obraża krytyków, a jednocześnie coraz częściej korzysta z materiałów i narracji środowisk radykalnych – trudno mówić o niewiedzy. W wielu przypadkach „przypadkowa” radykalizacja twórcy jest po prostu etapem przejściowym, gdy przekonuje się, że kontrowersja przynosi wzrost zasięgu.

Współpraca z organizacjami ekstremistycznymi

Połączenie influencerów i grup ekstremistycznych przyjmuje kilka form, od bardzo luźnych do silnie zinstytucjonalizowanych:

- Inspiracje i konsultacje – twórcy czerpią z materiałów propagandowych, cytują „think tanki” radykalnych środowisk, konsultują treści w zamkniętych czatach.

- Finansowanie pośrednie – wsparcie przez darowizny, sponsoring nieformalnych eventów, promowanie zrzutek „na niezależne media”, które de facto wspierają infrastrukturę ruchu.

- Koordynowane kampanie – seria podobnych treści u różnych twórców w tym samym czasie, z powtarzającymi się hasłami, linkami, narracjami. Często zbieżna z kalendarzem politycznym lub wydarzeniami kontrowersyjnymi.

Organizacje ekstremistyczne traktują influencerów jak „frontową” warstwę komunikacji. To oni nadają ton, memizują przekaz, dostosowują język do wieku i wrażliwości odbiorców. Ruch zyskuje miękką, popkulturową twarz zamiast surowych oświadczeń.

Przykład: komentator newsów przesuwający narrację

Przykładowy schemat wygląda następująco. Twórca startuje jako komentator aktualności: analizuje wybory, afery, zmiany prawa. Z czasem w każdym materiale pojawia się stały kozioł ofiarny: migranci, „lewacy”, „globaliści”, „zdrajcy narodu”. Argumenty stają się coraz bardziej jednostronne, pojawia się ironiczna dehumanizacja („szarańcza”, „pasożyty”, „podludzie”), a moderacja komentarzy przepuszcza jedynie najbardziej agresywne wpisy zgodne z linią autora.

Do tego dochodzą subtelne rekomendacje: książki, kanały, strony związane z ruchem ekstremistycznym, reklamowane jako „źródła prawdziwych informacji”. W końcu pojawia się odwołanie do konkretnych organizacji, demonstracji, zbiórek. Odbiorcy, którzy śledzili twórcę od dawna, przechodzą ten proces razem z nim, często nie zauważając, jak bardzo przesunęło się ich własne spektrum akceptowalnych poglądów.

Co wiemy, a czego nie wiemy o skali zjawiska

Trudności badawcze i zaciemnianie śladów

Skala działalności cyfrowych agitatorów jest trudna do dokładnego oszacowania. Badacze i organizacje monitorujące radykalizację online napotykają kilka powtarzających się przeszkód:

- Zamknięte grupy i kanały – część najbardziej skrajnych treści działa w zamkniętych społecznościach, do których trzeba zaproszenia lub rekomendacji.

- Znikające formaty – Stories, krótkotrwałe relacje, live’y bez zapisu, wiadomości w komunikatorach szyfrowanych.

- Platformy niszowe – migracje na alternatywne serwisy reklamowane jako „bez cenzury”, które rzadko są systematycznie monitorowane.

- Zmiana nicków i kanałów – po blokadach konta odradzają się w nowych konfiguracjach, przenosząc część społeczności.

Do tego dochodzi celowe fabrykowanie autentyczności: tworzenie wrażenia spontaniczności i „zwykłego użytkownika”, podczas gdy za plecami działa zaplecze organizacyjne – grafika, montaż, skoordynowane publikacje.

Dane z badań i ich ograniczenia

Badania nad „algorytmy a radykalizacja” czy nad tym, jak mikroinfluencerzy ekstremistyczni wpływają na młodych odbiorców, zwykle opierają się na ogólnodostępnych materiałach i deklaracjach użytkowników. Trudno zmierzyć realny efekt w postaci zmiany postaw, sympatii politycznych, gotowości do przemocy. Część osób nie przyznaje się do oglądania radykalnych treści, inni wręcz przeciwnie – chwalą się tym jako formą buntu.

Co wiemy? Influencerzy potrafią wzmocnić i przyspieszyć proces radykalizacji osób już podatnych na tego typu przekaz. Co pozostaje niewiadomą? Dokładny odsetek odbiorców, którzy przeszli pełną ścieżkę „od żartu do ekstremizmu” wyłącznie dzięki social mediom. Dane są fragmentaryczne, ale trend jest czytelny: rośnie liczba twórców, którzy łączą rozrywkę z ideologią ekstremistyczną w jednym kanale komunikacji.

Ekosystem propagandy cyfrowej: platformy, algorytmy, formaty

Środowisko technologiczne sprzyjające agitacji

Model biznesowy „uwaga za wszelką cenę”

Platformy społecznościowe zarabiają przede wszystkim na uwadze użytkowników. Im dłużej ktoś zostaje w aplikacji, tym więcej reklam zobaczy, tym więcej danych o swoich preferencjach wygeneruje. Algorytmy rekomendacji są zaprojektowane tak, by maksymalizować czas spędzony na platformie, nie zaś jakość czy rzetelność treści.

Ekstremalne materiały często spełniają dwa kryteria idealne z perspektywy biznesowej:

- są emocjonalnie silne – wywołują oburzenie, lęk, ekscytację,

- są polaryzujące – generują dyskusje, kłótnie, udostępnienia „z oburzenia”.

Cyfrowi agitatorzy potrafią świetnie wykorzystywać te mechanizmy. Tworzą treści, które nie tylko podobają się ich bazie fanów, ale także prowokują krytyków do reagowania, dzięki czemu algorytm uznaje je za „gorące” i podbija ich zasięgi.

Algorytmy a polaryzacja i wirusowość treści

Mechanizmy wirusowości treści opierają się na kilku powtarzalnych zasadach: nagły wzrost zaangażowania, silne emocje, szybkie reakcje. Materiały radykalne często je spełniają. Gdy influencer wypuszcza kontrowersyjny klip, w ciągu pierwszych minut zbiera:

- reakcje fanów („wreszcie ktoś mówi jak jest”),

- reakcje krytyków („to niedopuszczalne”),

- udostępnienia z komentarzem („patrzcie, co on gada!”).

Algorytm nie rozróżnia motywacji. Widzi tylko liczbę interakcji. Polaryzacja staje się więc cennym paliwem. Im ostrzejszy przekaz, tym większa szansa na „darmową” promocję przez samą platformę.

Efekt „króliczej nory” rekomendacji

Efekt „rabbit hole” polega na tym, że system rekomendacji, chcąc utrzymać użytkownika jak najdłużej, podsuwa mu materiały podobne, ale często odrobinę bardziej skrajne od tych, które już obejrzał. Osoba, która zaczyna od miękkiej krytyki „poprawności politycznej”, może dostać propozycje kanałów już otwarcie ekstremistycznych, bo algorytm zauważa, że podobni użytkownicy „też to oglądali”.

Cyfrowi agitatorzy budują swoje strategie tak, by wpisywać się w ścieżki rekomendacji. Dbają o tytuły, tagi, miniatury, które łączą ich materiały z popularnymi, mniej skrajnymi treściami. W ten sposób „doklejają się” do istniejących ścieżek konsumpcji treści i podprowadzają odbiorców krok po kroku w kierunku bardziej radykalnych narracji.

Platformy i ich specyfika w kontekście ekstremizmu

Serwisy wideo i krótkie formaty

Platformy oparte na wideo – od klasycznych serwisów z długimi materiałami po aplikacje krótkich filmików – są kluczowym polem działania cyfrowych agitatorów. Dają możliwość:

- emocjonalnej prezentacji (mowa ciała, ton głosu, scenografia),

- budowania wrażenia autentyczności (nagrania z domu, z ulicy, „bez montażu”),

- łatwego recyklingu treści – jeden dłuższy materiał można pociąć na serię krótkich klipów, które „podbijają” algorytm i stale przypominają o kanale.

Krótkie formaty sprzyjają intuicyjnemu przyswajaniu przekazu. Pojedynczy filmik z memem, żartem czy oburzającą sceną nie zawsze wygląda jak propaganda. Problem pojawia się wtedy, gdy użytkownik przez kilkanaście minut ogląda podobne treści pod rząd – oskarżenia, szyderstwo, te same wątki spiskowe. Wtedy mem przestaje być śmieszny, a zaczyna budować obraz świata, w którym „oni” są zagrożeniem, a „my” – ofiarą.

Twórcy ekstremistyczni dobrze rozumieją logikę feedu. Publikują regularnie, w seriach, często o stałych porach. To uczy odbiorców nawyku powrotu („sprawdzę, co dziś wrzucił”) i podnosi szanse, że algorytm uzna kanał za ważne źródło rozrywki lub informacji. Gdy już zbudują lojalność, przesunięcie akcentów – z „ostrej opinii” na jawny ekstremizm – odbywa się płynnie.

Komunikatory, serwisy niszowe i „drugi obieg”

Kolejną warstwą ekosystemu są komunikatory szyfrowane i platformy, które reklamują się hasłami wolności słowa. To tam często trafiają osoby „przefiltrowane” już przez otwarte serwisy. Publiczny profil czy kanał na dużej platformie bywa jedynie bramą wejściową. W opisie lub w relacjach pojawiają się zaproszenia do „prawdziwej dyskusji” w zamkniętej grupie.

W tym „drugim obiegu” zmienia się ton. Żarty i memy schodzą na dalszy plan, pojawiają się bardziej brutalne treści, wprost formułowane wezwania („przygotujmy się”, „czas działać”), instrukcje, porady logistyczne. Użytkownicy mają wrażenie, że są w „elitarnej” wspólnocie wtajemniczonych, co dodatkowo zwiększa odporność na krytykę spoza grupy.

Serwisy niszowe pełnią też rolę zaplecza technicznego. Gdy duże platformy usuwają ekstremalne materiały, często są one nadal dostępne „w lustrze” na mniej znanych stronach. Cyfrowi agitatorzy linkują do nich w sposób zawoalowany: przez skracacze linków, grafiki z QR-kodami albo instrukcje w stylu „wygooglujcie sobie nazwę – wiecie którą”. To utrudnia moderację i śledzenie rozpowszechniania treści.

Gry, czaty głosowe i przestrzenie półprywatne

Coraz częściej miejscem agitacji stają się gry online i związane z nimi czaty. Rozmowy na głos, wspólne mecze, gildie czy klany tworzą luźne, ale trwałe więzi. W takiej atmosferze łatwo „wrzucić” żart z podtekstem ideologicznym, potem filmik, a w końcu link do kanału z radykalnymi treściami. Łączy się rozrywkę, poczucie wspólnoty i stopniowe oswajanie z wrogim językiem.

Półprywatne przestrzenie – serwery na popularnych komunikatorach, zamknięte fora, czaty głosowe – mają jeszcze jedną cechę: brak świadków z zewnątrz. Nie ma tam zwykle dziennikarzy, badaczy ani bliskich osób, które mogłyby zakwestionować radykalne treści. To sprzyja normalizacji. Gdy na kanale głosowym przez godzinę słyszy się homofobiczne czy rasistowskie żarty, próg wrażliwości przesuwa się praktycznie niepostrzeżenie.

Cyfrowy agitator funkcjonuje więc równocześnie w kilku warstwach ekosystemu: od otwartych platform wideo, przez krótkie formaty w feedach, po zamknięte czaty i serwisy niszowe. Z perspektywy odbiorcy to często ciągłość – ten sam głos, ta sama twarz, tylko coraz mniej masek i coraz mniej ograniczeń. Zrozumienie tych połączeń jest kluczowe, jeśli pytamy: co wiemy o sile oddziaływania takich twórców, a czego wciąż nie umiemy zmierzyć ani skutecznie ograniczyć.

Od estetyki buntu do estetyki nienawiści

Cyfrowi agitatorzy rzadko zaczynają od wprost deklarowanej nienawiści. Częściej opowiadają historię osoby zbuntowanej, „zmęczonej kłamstwami mediów”, „duszącej się w świecie poprawności politycznej”. Ten wizerunek buntownika ma kilka stałych elementów:

- styl „antysystemowy” – fryzury, ubrania, tatuaże, scenografia kojarząca się z subkulturą, undergroundem lub „prawdziwą ulicą”,

- estetyka DIY – pozornie amatorskie nagrania z telefonu, bałagan w kadrze, „nagrywam jak leci, bo ważniejsza jest prawda niż jakość”,

- sygnały tożsamościowe – symbole, barwy, numeracje, gesty dłoni rozpoznawalne dla wtajemniczonych, niewinne dla reszty.

Na początku to estetyka buntu – atrakcyjna dla tych, którzy szukają odmienności. Z czasem w ten sam szkielet wizualny wprowadzane są coraz twardsze treści: plakaty z historycznymi postaciami skrajnych ruchów w tle, cytaty z radykalnych ideologów wplecione w grafiki motywacyjne, muzyka z tekstami o „oczyszczaniu”, „odrodzeniu narodu”, „prawdziwych mężczyznach”.

Co wiemy? Estetyka jest często pierwszym filtrem: przyciąga, zanim odbiorca w ogóle skupi się na treści. Czego nie wiemy? Na ile sama warstwa wizualna przyspiesza akceptację późniejszych, jawnie nienawistnych komunikatów, gdy już powstanie więź z twórcą.

Język memów, ironii i „żartów, których nie wolno brać na serio”

Jednym z najskuteczniejszych narzędzi cyfrowych agitatorów jest ironia. Kontrowersyjny przekaz rzadko podawany jest „na serio” od pierwszego dnia. Częściej ma formę:

- „tylko żartu”,

- „trollingu”,

- „testowania granic poprawności politycznej”.

Mem z przerysowaną karykaturą jakiejś grupy społecznej, podpisany „spokojnie, to ironia”, pozwala twórcy uciec od odpowiedzialności. Jeśli pojawi się krytyka, natychmiast pojawia się kontrnarracja: „nie rozumieją sarkazmu”, „polowanie na czarownice”, „przecież to mem”. Jednocześnie stali odbiorcy wiedzą, że to „nasz żart”, sygnał, że „my wiemy, jak jest naprawdę”.

W kolejnych krokach żart staje się kodem grupowym. Określenia uznawane powszechnie za obraźliwe funkcjonują w społeczności jako ironiczne przezwiska. Kto zaczyna używać takiego języka, pokazuje, że „wchodzi do środka”. Kto się wzbrania – „jeszcze nie dojrzał”, „jest uśpiony przez media”.

Język jest też oczyszczany z dosłowności. Zamiast mówić „przemoc” – „sprzątanie”, zamiast „mniejszość X” – „oni”, „tamci”, „goście”, „przybysze”. W komentarzach rośnie liczba eufemizmów i skrótów, które pozwalają mówić o radykalnych rozwiązaniach w sposób łatwiejszy do przełknięcia.

Narracje: od krzywdy jednostki do „wojny cywilizacji”

Treści ekstremistyczne rzadko pojawiają się w próżni. Są osadzone w szerszych opowieściach o świecie. Kilka schematów powtarza się wyjątkowo często:

Motyw „oszukanych i zdradzonych”

Cyfrowy agitator przyjmuje rolę kogoś, kto przejrzał na oczy. Opowiada historię o własnej krzywdzie: zwolnieniu z pracy „za poglądy”, cenzurze konta, utracie znajomych, konflikcie z „lewackim” wykładowcą. Nawet jeśli fakty są niepełne lub podkoloryzowane, przekaz jest jasny: „system” karze za mówienie „prawdy”.

Ta osobista narracja łączy się z szerszym obrazem społeczeństwa. Nie jest to już drobna niesprawiedliwość, ale dowód na spisek elit przeciw zwykłym ludziom. Z biegiem czasu opowieść ewoluuje w stronę tezy, że „oni” nie tylko rządzą, ale wręcz planują zniszczenie „naszego” stylu życia.

Motyw „oblężonej twierdzy”

Drugi stały motyw to wizja stałego zagrożenia. Obrazy „zalewających nas fal”, „inwazji”, „wymiany ludności”, „seksualizacji dzieci przez ideologię”. Ten język buduje poczucie, że sytuacja jest kryzysowa, a każda forma obrony – nawet skrajna – może być uznana za zrozumiałą.

Nowe informacje – o kryzysach, przestępstwach, pojedynczych kontrowersyjnych akcjach aktywistów – są doklejane do tej ramy. Każda wiadomość staje się „kolejnym dowodem”, że w tle istnieje wielki plan zniszczenia „normalnego świata”. W ten sposób przypadkowe zdarzenia układają się w jedną, spiskową narrację.

Motyw „odrodzenia” i „przywracania porządku”

Gdy wizja zagrożenia zostanie oswojona, pojawia się wątek nadchodzącego przełomu. Z jednej strony jest mowa o „dnie”, do którego społeczeństwo ma rzekomo zmierzać, z drugiej – o „odrodzeniu” i „porządku”, które przyjdą dzięki „prawdziwym patriotom”, „prawdziwym wiernym” czy „prawdziwym mężczyznom”.

To przejście jest kluczowe: z frustracji i lęku rodzi się poczucie misji. Radykalne pomysły nie są już przedstawiane jako agresja, ale jako „leczenie”, „oczyszczanie”, „przywracanie naturalnego stanu rzeczy”. W takiej ramie nawet przemoc może zostać zracjonalizowana jako „obrona konieczna w wojnie, którą oni zaczęli”.

Od sympatii do lojalności: jak rośnie wpływ cyfrowego agitatora

Budowanie bliskości: codzienność, wyznania, backstage

W praktyce wielu ekstremistycznych influencerów zaczyna od lifestylu. Pokazują mieszkanie, treningi, zakupy spożywcze, wyjazdy na wakacje. Odbiorca śledzi ich dzień, przyzwyczaja się do głosu, żartów, sposobu mówienia. Radykalne wątki wplatają w tę codzienność – jak mimochodem, przy porannej kawie albo w drodze na siłownię.

Ten zabieg ma prosty efekt psychologiczny: kontrowersyjne opinie nie padają z ust obcego „fanatyka”, ale kogoś, kogo widzi się co dzień, kogo kojarzy się z normalnością. Gdy taka osoba opowiada o swoich lękach, problemach zdrowotnych, konfliktach rodzinnych, buduje się efekt „znam go / ją naprawdę”. To silna baza, na której można później oprzeć lojalność wobec przekazu politycznego.

Mechanika „my kontra oni” w społeczności

Wokół cyfrowego agitatora szybko powstaje mikrospołeczność: stałe nicki w komentarzach, prywatne żarty, nawiązania do poprzednich streamów. Z zewnątrz to zwykły fandom. W środku rosną jednak wyraźne granice:

- „my” – lojalni, „kumaci”, wiedzący „jak jest naprawdę”,

- „oni” – krytycy, „trolle”, „lewactwo”, „media głównego nurtu”, „system”.

Każda krytyka z zewnątrz może zostać zinterpretowana jako atak na całą grupę. Gdy pojawi się artykuł demaskujący manipulacje twórcy, reakcją bywa fala komentarzy: „atakują naszego”, „boją się prawdy”, „wiedziałem, że w końcu go ruszą”. W ten sposób rośnie nie tylko sympatia, ale właśnie lojalność – obrona lidera staje się obroną własnej tożsamości.

Stopniowanie przekazu i testowanie granic

Nie każdy nowy odbiorca od razu trafi na najbardziej skrajne materiały. Często kanał jest podzielony na warstwy:

- treści „frontowe” – memy, komentowanie bieżących wydarzeń, „śmieszne” reakcje na viralowe nagrania,

- treści „środkowe” – dłuższe analizy, opowieści o „prawdziwych przyczynach” tego, co dzieje się w polityce lub kulturze,

- treści „rdzeniowe” – nagrania kierowane do najbardziej oddanych, w których pojawiają się wprost deklaracje ideologiczne, rekomendacje lektury, wezwania do konkretnych zachowań.

Cyfrowy agitator obserwuje, kto gdzie zostaje. Osoby, które reagują chętnie na treści środkowe, dostają więcej linków do materiałów „rdzeniowych”: w relacjach, newsletterze, na zamkniętych czatach. Ci, którzy protestują lub odchodzą, są interpretowani jako „słabi”, „niegotowi”. Dla reszty to dodatkowy sygnał, że wchodzą do węższego, bardziej zdecydowanego kręgu.

Influencer w maszynie propagandy i dezinformacji

Przekaźnik, nie tylko twórca treści

Cyfrowy agitator rzadko działa w pełni samotnie. Niezależnie od tego, czy formalnie należy do jakiejś organizacji, w praktyce współtworzy większy ekosystem propagandowy. Zdarza się, że dostaje gotowe materiały: dokumenty, grafiki, linki do „analiz”, które ma „tylko skomentować” na live. Dla odbiorców to nadal „autorski” głos, choć faktyczne źródło przekazu bywa inne.

Z punktu widzenia nadawcy kampanii (partii, ruchu, zewnętrznego ośrodka wpływu) influencer jest wzmacniaczem: wchodzi z przygotowanym przekazem w istniejące już społeczności, które mu ufają. Dzięki temu wiadomość nie wygląda jak reklama polityczna, ale jak „szczera opinia” kogoś, kogo „śledzimy od dawna”.

Koordynacja i „chorusy” przekazu

W okresach napięć – wyborów, protestów, kryzysów międzynarodowych – widać zbieżność działań wielu twórców. W krótkim czasie powtarzają te same hasła, te same ramy interpretacyjne, często te same sformułowania. Czasem jest to efekt spontaniczny: popularne memy i argumenty szybko się kopiują. Zdarza się jednak koordynacja – ustalanie wspólnych linii ataku w prywatnych grupach, na komunikatorach szyfrowanych, w zamkniętych kanałach „dla twórców”.

W efekcie odbiorca ma wrażenie, że „wszyscy niezależni twórcy mówią to samo”. To wzmacnia wiarygodność opowieści („przecież oni się nie znają, a dochodzą do tych samych wniosków”). Badawczo trudne jest odróżnienie spontanicznego „chóru” od skoordynowanej operacji, ale oba zjawiska zwiększają zasięg ekstremalnych narracji.

Dezinformacja w atrakcyjnej formie

Fałszywe informacje zwykle nie wyglądają jak klasyczne „fake newsy” z anonimowych stron. Często są wplecione w osobisty komentarz influencera: „mam znajomego policjanta, który mówi, że…”, „nie mogę pokazać dokumentów, ale zaufajcie mi, bo…”. Brak źródeł jest tuszowany stylem „kulisy, których wam nie pokażą w telewizji”.

Dezinformacja staje się też memiczna. Krótkie, łatwe do zapamiętania hasła, grafiki z „wyliczankami faktów”, które faktami nie są, proste porównania („przy jednych można, przy drugich nie wolno”) – wszystko to ułatwia szybkie przyjęcie przekazu. Dopiero szczegółowa weryfikacja pozwala odróżnić, co jest prawdą, a co manipulacją. Tyle że większość odbiorców nie robi takiej weryfikacji, bo zaufanie do twórcy zastępuje krytyczne myślenie.

Monetyzacja: propaganda jako produkt

Model biznesowy digitalowych agitatorów jest częścią problemu. Radykalny przekaz jest produktem: napędza wyświetlenia, subskrypcje, zakupy w sklepie internetowym (koszulki, książki, gadżety), wpłaty w serwisach patronackich czy kryptowalutach. Im silniejsze emocje wywoła, tym więcej pieniędzy może przynieść.

W praktyce oznacza to, że polaryzacja się opłaca. Twórca, który złagodzi ton, ryzykuje spadek zaangażowania. Ten, który idzie dalej, może liczyć na nagrodę w postaci lojalniejszych fanów, gotowych płacić za „prawdziwą treść, której już nigdzie nie wolno mówić”. Ekstremizm staje się więc nie tylko projektem ideologicznym, ale i modelem kariery.

Szare strefy odpowiedzialności: platforma, twórca, odbiorca

Na koniec pozostaje pytanie, które wraca w debacie publicznej: kto odpowiada za skutki cyfrowej agitacji? Platformy, które zarabiają na zasięgach? Twórcy, którzy świadomie balansują na granicy regulaminu? A może odbiorcy, którzy nagradzają radykalny przekaz uwagą i pieniędzmi?

Regulacje platform działają nierówno i z opóźnieniem. Część treści jest usuwana, ale inne – podobne w tonie i skutkach – pozostają, bo mieszczą się w luce między „dopuszczalną kontrowersją” a wprost zdefiniowanym „mową nienawiści”. Moderacja algorytmiczna reaguje głównie na słowa kluczowe, podczas gdy cyfrowi agitatorzy uczą się grać aluzją, ironią, kodami. Formalnie nie łamią zasad, faktycznie podtrzymują klimat pogardy, teorii spiskowych i przemocy symbolicznej.

Sam twórca często zasłania się formułą „tylko zadaję pytania”, „jestem satyrykiem”, „to moje prywatne zdanie”. Gdy dochodzi do realnych szkód – nękania konkretnych osób, gróźb pod adresem mniejszości, ataków na instytucje – odpowiedzialność rozmywa się między „przecież nikogo do niczego nie namawiałem” a „to tylko reakcja widzów”. Z prawnego punktu widzenia granica bywa cienka; z perspektywy skutków społecznych widać jednak ciągłość między stylem narracji a zachętą do działania.

Odbiorca nie jest tu jedynie ofiarą manipulacji. Podejmuje wybór: subskrybuje, udostępnia, wpłaca pieniądze, pojawia się na wydarzeniach offline. Ten wybór nie zawsze jest w pełni świadomy – działa presja grupy, algorytm, zmęczenie informacyjne – ale nie da się go całkowicie wyłączyć z łańcucha odpowiedzialności. Pytanie brzmi więc nie tylko „kto zawinił?”, lecz także „kto mógł zareagować wcześniej, a tego nie zrobił?”.

Dyskusja o regulacjach – od demonetyzacji, przez ograniczanie zasięgów, po sankcje karne – będzie powracać przy każdym głośnym przypadku cyfrowej radykalizacji. Niezależnie od przyjętych rozwiązań formalnych, o sile ekstremistycznych influencerów współdecyduje coś prostszego: gotowość użytkowników do zatrzymania się przy treści, która „dobrze się klika”, i zadania podstawowego pytania: kto na tym korzysta i do czego ma mnie to popchnąć?

Cyfrowi agitatorzy nie znikną wraz ze zmianą jednej ustawy czy regulaminu platformy; zmieniają się razem z technologią i nastrojami społecznymi. Od tego, czy potrafimy rozpoznawać ich strategie, oddzielać emocję od manipulacji i budować alternatywne wzorce wpływu, zależy, czy ekosystem sieci będzie przede wszystkim polem radykalizacji, czy przestrzenią sporu, który nie kończy się przemocą.

Techniki rozbrajania: jak osłabić wpływ cyfrowych agitatorów

Widoczność mechanizmów zamiast piętnowania odbiorców

Publiczne dyskusje o ekstremistycznych influencerach często koncentrują się na potępieniu „naiwnych odbiorców”. W praktyce takie podejście rzadko pomaga. Osoby, które już czują się wyśmiewane lub marginalizowane, tym mocniej kurczą się w bańce własnej społeczności.

Skuteczniejsza bywa demaskacja metod, a nie wyłącznie intencji. Zamiast oceniać ludzi („wierzysz w bzdury”), lepiej pokazać kroki manipulacji:

- gdzie pojawia się fałszywa alternatywa „albo my, albo oni”,

- w którym momencie przechodzi się od pojedynczego faktu do uogólnienia na „całą grupę”,

- jak działa powiązanie treści z ofertą sprzedażową („kup mój kurs, żeby dowiedzieć się reszty prawdy”).

Osoby, które polubiły twórcę, rzadko zareagują na frontalny atak. Czasem jednak zatrzymają się przy pytaniu: „co konkretnie jest tu faktem, a co opinią?”. To pierwszy moment pęknięcia wizerunku nieomylnego lidera.

Kontrnarracje zamiast cenzury totalnej

Usunięcie konta skrajnego influencera powstrzymuje część szkodliwych treści, ale nie rozwiązuje problemu zapotrzebowania na radykalne opowieści. Odbiorcy przenoszą się wtedy na inne platformy lub do mniej widocznych przestrzeni.

Badania nad propagandą pokazują, że skuteczne bywa budowanie alternatywnych narracji w tych samych obszarach tematycznych: bezpieczeństwo, tożsamość, przyszłość ekonomiczna. Nie chodzi o „ładniejsze opakowanie” tych samych haseł, lecz o odpowiedź na realne lęki w innym języku niż „wojna ze wszystkimi”.

Kontrnarracje tworzą często lokalne inicjatywy: kanały młodych aktywistów, podcasty eksperckie, profile edukacyjne. Gdy potrafią mówić prostym językiem i nie traktują odbiorców jak „niedouczonej masy”, mogą odebrać ekstremistom część widowni, która szukała przede wszystkim zrozumienia, a nie przemocy.

Wczesna edukacja medialna jako profilaktyka

W przestrzeni publicznej dużo mówi się o edukacji medialnej, ale rzadko przekłada się to na codzienną praktykę szkół czy domów. Tymczasem odporność na cyfrową agitację buduje się wcześniej niż w momencie pierwszego kontaktu z radykalną treścią.

Podstawowe kompetencje, których brakuje wielu dorosłym i nastolatkom:

- odróżnianie faktu od komentarza (również w memach i „śmiesznych filmikach”),

- rozpoznawanie technik emocjonalnych (szantaż moralny, ośmieszanie, „wszyscy rozsądni myślą tak jak ja”),

- sprawdzanie źródeł poza jednym ulubionym kanałem na wideo lub jednym profilem na portalu społecznościowym,

- świadomość, że algorytm nie jest „obiektywną rzeczywistością”, tylko maszyną wzmacniającą to, co przyciąga uwagę.

Nie chodzi o tworzenie kolejnego szkolnego przedmiotu z testem na końcu semestru. Skuteczniejsze bywają krótkie ćwiczenia: analiza popularnego filmiku pod kątem technik perswazji, porównanie nagłówków z różnych mediów, rozpisanie łańcucha „kto na tym zyskuje”.

Granice wolności słowa w epoce influencerów

Między ochroną debaty a walką z radykalizacją

Konflikt między ochroną wolności słowa a przeciwdziałaniem ekstremizmowi powraca przy każdej głośnej blokadzie konta. Influencerzy przedstawiają się często jako ofiary cenzury „systemu”, co dodatkowo zwiększa ich atrakcyjność w oczach części odbiorców.

Spór dotyczy kilku konkretnych pytań: co uznajemy za realne podżeganie do przemocy, a co za ostre, ale dopuszczalne opinie? Gdzie przebiega linia między krytyką grup społecznych a dehumanizacją, która stwarza klimat przyzwolenia na ataki?

Regulacje krajowe i wewnętrzne standardy platform nie zawsze są spójne. Dla jednych państw priorytetem będzie walka z terroryzmem, dla innych – z mową nienawiści wobec konkretnych mniejszości. Influencerzy sprawnie wykorzystują te różnice, przenosząc działalność na serwery z łagodniejszym prawem lub na platformy mniej wrażliwe na presję opinii publicznej.

„Efekt boomerangu” i mit zakazanego owocu

Usuwanie treści skrajnych bywa przedstawiane jako najlepsze rozwiązanie. Praktyka pokazuje jednak, że działanie „z góry” może wywołać efekt boomerangu: część widzów jeszcze mocniej przykleja się do przekazu, uznając go za „prawdę, której się boją”.

Widzimy to przy przenosinach na mniejsze, mniej regulowane platformy. Konta, które znikają z dużych serwisów, często ogłaszają „emigrację” do własnych aplikacji, prywatnych forów, komunikatorów. Publiczna moderacja zostaje wtedy zastąpiona szczelną bańką, w której nie ma już sporadycznych głosów sprzeciwu. Radykalizacja może tam przebiegać szybciej, bo nikt z zewnątrz nie podważa narracji lidera.

To nie argument przeciwko moderacji, lecz sygnał, że musi być łączona z innymi działaniami: przejrzystymi uzasadnieniami decyzji, programami edukacyjnymi i wsparciem dla bezpieczniejszych alternatywnych przestrzeni dyskusji.

Nowe pola ekspansji: gry, platformy niszowe, metawersum

Gry online i społeczności graczy

Cyfrowi agitatorzy coraz częściej wychodzą poza klasyczne media społecznościowe. Jednym z pól, gdzie szukają odbiorców, są gry sieciowe i związane z nimi społeczności – od czatów głosowych po serwery prywatne.

W grach zespołowych naturalnie tworzą się składy, gildie, klany. Hierarchie, wspólne zadania, rytuały – to wszystko sprzyja budowaniu lojalności. Jeżeli w takim środowisku pojawi się lider z mocnymi poglądami, może zacząć przenosić dyskusję z wątków o taktyce rozgrywki na tematy polityczne, społeczne, tożsamościowe.

Część z tych działań jest trudna do monitorowania, bo odbywa się w czasie rzeczywistym i w zamkniętych grupach głosowych. Z zewnątrz widać tylko skutek: przejście części graczy do wspólnych kanałów na komunikatorach, gdzie stopniowo pojawia się coraz twardszy przekaz.

Platformy niszowe i komunikatory szyfrowane

Gdy duże serwisy zwiększają presję na treści ekstremistyczne, cyfrowi agitatorzy przenoszą się do niszowych aplikacji i na komunikatory z silnym szyfrowaniem. Tam budują struktury bardziej przypominające tradycyjne organizacje: z hierarchią, zadaniami, wewnętrzną dyscypliną.

Publiczny profil na dużej platformie bywa tylko „witryną” – miejscem przyciągania nowych osób. Prawdziwe centrum aktywności, wraz z radykalniejszymi treściami, znajduje się na zamkniętym kanale, do którego dostęp dostaje się po wstępnej „weryfikacji”: serii interakcji, obecności na live’ach, wsparciu finansowym.

Z punktu widzenia służb i organizacji monitorujących ekstremizm to poważne wyzwanie. O ile otwarte profile można analizować automatycznie, o tyle prywatne grupy wymagają innych metod: obserwacji z wewnątrz, współpracy z osobami, które decydują się wyjść z takiego środowiska.

Metawersum i rozszerzona rzeczywistość

Eksperymenty z przestrzeniami wirtualnymi i rozszerzoną rzeczywistością dopiero się rozwijają, ale już teraz budzą pytania o nowe formy agitacji. Spotkania w trójwymiarowych światach, awatary, możliwość inscenizowania wydarzeń historycznych lub „przyszłych scenariuszy” – to potencjalne narzędzia kształtowania emocji i lojalności.

Wyobrażalne są „wydarzenia specjalne” organizowane przez skrajne grupy: wirtualne marsze, „rekonstrukcje” bitew przedstawione w stronniczy sposób, treningi paramilitarne w środowisku gry, które na pierwszy rzut oka wygląda jak zwykła rozrywka. Granica między zabawą a przygotowaniem psychologicznym do działań w realnym świecie może się tu zacierać.

Rola dziennikarzy, badaczy i organizacji obywatelskich

Śledztwa cyfrowe i dokumentowanie nadużyć

W pracy z ekstremistycznymi influencerami dziennikarze śledczy i badacze cyfrowi napotykają kilka powtarzających się przeszkód: krótkotrwałość treści (kasowane live’y, znikające stories), złożone sieci kont zapasowych, przenikanie się sfery publicznej i prywatnej.

Rosną znaczenie archiwów społecznych: projektów, które automatycznie zapisują kontrowersyjne materiały, zanim zostaną usunięte lub zmodyfikowane. Dzięki temu możliwe jest późniejsze odtworzenie procesu radykalizacji, a nie tylko pojedynczych „wpadek”.

Równolegle rozwija się dziedzina tzw. OSINT – otwartych źródeł informacji. Badacze łączą ślady pozostawiane przez influencerów: daty publikacji, linki do zewnętrznych stron, powiązane domeny, aktywność w innych kanałach. Tak można zrekonstruować, kto komu przekazuje treści, kto je finansuje, jak wyglądają sieci wzajemnego wzmacniania.

Współpraca zamiast równoległych inicjatyw

Organizacje pozarządowe, instytucje publiczne, środowiska akademickie i redakcje często działają równolegle, badając te same zjawiska z różnych stron. Brakuje jednak mechanizmów, które pozwalałyby szybko wymieniać się obserwacjami i danymi, zachowując przy tym ochronę źródeł i standardy etyczne.

W niektórych krajach powstają konsorcja monitorujące, łączące kompetencje techniczne, prawnicze i komunikacyjne. Jedni specjalizują się w analizie sieci i botów, inni – w prawnych aspektach mowy nienawiści, jeszcze inni – w działaniach pomocowych dla osób wychodzących z ruchów ekstremistycznych. Jeśli te kompetencje pozostają rozproszone, cyfrowi agitatorzy mają przewagę: działają szybciej i elastyczniej niż instytucje.

Bezpieczeństwo osób krytykujących ekstremistów

Osoby, które publicznie opisują praktyki ekstremistycznych influencerów, często stają się celem zorganizowanych kampanii nękania. To nie jest efekt uboczny, ale świadoma strategia zastraszania i zniechęcania innych do krytyki.

Fale hejtu, doxing (ujawnianie prywatnych danych), zgłoszenia do pracodawców – te praktyki mają pokazać, że „atak na naszego twórcę” będzie kosztowny. Bez systemowego wsparcia (prawnego, psychologicznego, technicznego) dla osób narażonych na takie działania, przestrzeń publiczna kurczy się: mniej ludzi decyduje się mówić otwarcie.

Niektóre redakcje i organizacje tworzą już procedury bezpieczeństwa cyfrowego: standardy anonimizacji, szkolenia z ochrony kont, szybkie ścieżki kontaktu z platformami. To żmudna, mało spektakularna praca, ale bez niej równowaga sił między agitatorami a ich krytykami pozostaje zachwiana.

Codzienne strategie użytkowników: mikroodporność w praktyce

Świadome „odsubskrybowanie” emocjonalne

Formalne kliknięcie „przestań obserwować” nie zawsze oznacza realne odcięcie od wpływu. Współczesne platformy nadal podsuwają treści lub dyskusje związane z dawnym idolem. Przerwanie więzi z cyfrowym agitorem wymaga często czegoś więcej niż zmiany ustawień.

Pomagają proste kroki:

- czasowe wyciszenie słów kluczowych i tematów, które napędzały radykalne emocje,

- zastąpienie „pustki po treściach” innymi źródłami – kanałami o zbliżonej tematyce, ale innym stylu,

- rozmowa z kimś spoza bańki, kto nie wyśmiewa, lecz dopytuje: co dokładnie tam było dla ciebie ważne?

Dla części osób to wystarczające, żeby dystansować się od skrajnego przekazu. Inni potrzebują bardziej sformalizowanej pomocy: grup wsparcia, konsultacji z psychologiem, wsparcia doradców pracujących z osobami wychodzącymi ze środowisk ekstremistycznych.

Małe decyzje, które zmieniają zasięgi

Algorytmy reagują na drobiazgi: kliknięcie w film, zatrzymanie się na nim przez kilkanaście sekund, przewinięcie komentarzy. Użytkownik nie musi „lubić” treści, by przyczyniać się do jej rozprzestrzeniania – wystarczy, że będzie się przy niej dłużej zatrzymywał z ciekawości czy oburzenia.

Jeżeli cyfrowy agitator opiera wpływ na wzmacnianiu polaryzacji, każda fala oburzonych wejść podkręca jego pozycję w algorytmie. Decyzja, by nie kliknąć w sensacyjny tytuł, przejść dalej, nie włączać filmu, który „wszyscy komentują”, wygląda na gest symboliczny, ale składa się z niego realny sygnał do systemu rekomendacji.

Pytanie „kto na tym korzysta i do czego ma mnie to popchnąć?” można zadawać nie tylko twórcom, ale i samym platformom. Algorytmy nie są neutralne – zostały zaprojektowane tak, by maksymalizować zaangażowanie. Świadoma gra z tym mechanizmem (ograniczanie czasu, wybór innych źródeł, zgłaszanie szkodliwych treści) jest jednym z niewielu narzędzi, którymi przeciętny użytkownik realnie dysponuje.

Kim jest „cyfrowy agitator”? Nowy typ influencera ekstremistycznego

Od lidera opinii do lidera tożsamości

Klasyczny influencer sprzedaje głównie styl życia, produkty, czasem idee. Cyfrowy agitator idzie krok dalej: sprzedaje tożsamość i przynależność. Proponuje odbiorcy prostą odpowiedź na pytanie „kim jesteś i po czyjej stronie stoisz?”.

W praktyce to połączenie ról: showmana, mentora, „starszego brata” i nieformalnego kaznodziei. Na poziomie faktów widzimy regularne transmisje, serie filmów, memy, newslettery. Na poziomie funkcji społecznej – kogoś, kto przejmuje część roli, którą kiedyś pełniły organizacje, wspólnoty, partie czy grupy rówieśnicze offline.

Cyfrowy agitator nie zawsze jawnie nawołuje do przemocy czy łamania prawa. Częściej operuje pasem startowym: opowieściami o zagrożonej wspólnocie, „przebudzeniu” i konieczności „stawiania oporu”. Konkretny ekstremistyczny ruch może pojawić się dopiero później, jako „logiczny krok” dla tych, którzy już przyjęli tę narrację.

Profile psychologiczne i społeczne

Badania nad cyfrowymi agitatorami pokazują kilka powtarzających się cech. To nie jest katalog obowiązkowy, raczej zestaw dominujących tendencji:

- wysoka sprawność komunikacyjna – umiejętność szybkiego reagowania na krytykę, obracania zarzutów w żart, modulowania tonu między agresją a czułością wobec „swoich”,

- silna potrzeba kontroli narracji – wyznaczanie granic dyskusji, ustawianie „wrogów” i „sojuszników”, przerywanie wątpliwości tekstami o nielojalności lub „braku odwagi”,

- zawieszona odpowiedzialność – agresywne treści pojawiają się poprzez cytaty, memy, „pytania do widzów”, rzadko jako wprost formułowane wezwania,

- hybryda autentyczności i kreacji – prywatne wątki są starannie dozowane, by budować bliskość, ale nie odsłaniać realnych struktur i powiązań.

Po stronie społecznej widoczny jest jeszcze jeden element: próżnia instytucjonalna. Agitatorzy zapełniają lukę tam, gdzie młodzi ludzie nie znajdują wiarygodnych przewodników w świecie polityki, religii czy debat publicznych. To nie jest usprawiedliwienie, tylko opis kontekstu, w którym taki typ lidera zyskuje na znaczeniu.

Granica między „kontrowersyjnym twórcą” a agitacją

Nie każdy ostry komentator polityczny jest cyfrowym agitatorem. Kluczowe są trzy elementy, które występują razem:

- systematyczność – przekaz ekstremistyczny lub skrajnie polaryzujący nie pojawia się incydentalnie, ale jako stały element treści,

- infrastruktura – wokół twórcy buduje się sieć kanałów, grup, symboli, które utrwalają i pogłębiają przekaz,

- przekierowanie do działania – nawet jeśli nie jest jawne, użytkownik dostaje wskazówki, gdzie pójść dalej: zamknięte czaty, wydarzenia offline, wsparcie dla konkretnych grup.

Co wiemy? Łatwiej uchwycić pojedyncze, drastyczne wypowiedzi niż długotrwały proces budowania lojalności. Czego nie wiemy? Jak często odbiorcy przechodzą z roli biernych widzów do aktywnych uczestników ekstremistycznych działań – dane są tu niepełne i rozproszone.

Ekosystem propagandy cyfrowej: platformy, algorytmy, formaty

Platformy głównego nurtu jako „lejki rekrutacyjne”

Najbardziej radykalne treści rzadko zaczynają się w przestrzeniach niszowych. Pierwszy kontakt często następuje na dużych platformach: serwisach wideo, portalach z krótkimi formami, mainstreamowych komunikatorach. To tam agitator testuje memy, hasła, formaty, sprawdzając, co generuje najwięcej reakcji.

W praktyce wygląda to jak klasyczna praca marketingowa: analiza statystyk, testy A/B tytułów, mini-serie poświęcone pojedynczym kontrowersjom, które mają przyciągnąć odbiorców do dłuższych materiałów. Ekstremistyczny rdzeń bywa „zaszyty” w serii ogólniejszych treści – np. o kryzysach gospodarczych, migracji czy „kulturze unieważniania”.

Algorytmy rekomendacji pełnią rolę cichego współuczestnika. Nie „wspierają ekstremizmu”, ale promują to, co generuje silne emocje i długie oglądanie. Cyfrowi agitatorzy uczą się tego w praktyce: wiedzą, że warto korzystać z formatów, które algorytm lubi – krótkich klipów, chwytliwych tytułów, głośnych dyskusji na żywo.

Platformy pośrednie: serwisy o luźniejszej moderacji

Gdy przekaz staje się ostrzejszy, część twórców przenosi bardziej kontrowersyjne materiały do serwisów o niższych standardach moderacji lub o innym modelu odpowiedzialności za treści (np. płatne platformy subskrypcyjne, mniej popularne hostingi wideo).

Mechanizm jest powtarzalny:

- Na platformach głównego nurtu – zapowiedzi, skróty, komentarze do „cenzurowanych” materiałów.

- Na platformach pośrednich – pełne nagrania, „zakazane” analizy, treści balansujące na granicy dopuszczalności prawnej.

- W zamkniętych kanałach – instrukcje działania, wewnętrzne dokumenty, koordynacja grup.

Tak buduje się kaskadę przepływu od lekkiej kontrowersji do twardego ekstremizmu. Formalnie każda warstwa może bronić się, że „tylko komentuje” lub „tylko podaje link dalej”. W całości jednak powstaje spójny ekosystem propagandy.

Algorytmy rekomendacji jako niezamierzony sprzymierzeniec

Systemy rekomendujące treści działają według jasnych zasad biznesowych: zatrzymać użytkownika jak najdłużej, przewidzieć, co go „wciągnie”. Ekstremistyczni influencerzy nie muszą znać kodu, by korzystać z tych mechanizmów. Wystarczy obserwacja: które filmy rosną najszybciej, jakie tematy podbijają statystyki, po jakich słowach kluczowych przychodzą nowi odbiorcy.

Najczęściej wykorzystywane są trzy cechy algorytmów:

- efekt „tunelu” – po kilku interakcjach z treściami o podobnej tematyce system zaczyna proponować coraz mocniejsze warianty tego samego wątku,

- premiowanie kontrowersji – materiały z dużą liczbą interakcji w krótkim czasie trafiają szerzej, nawet jeśli część reakcji to krytyka,

- łączenie wątków – nagrania łączące kilka gorących tematów (np. pandemię, migrację, wojnę) szybciej trafiają do różnych baniek odbiorców.

Stąd strategie typu „clickbait ideologiczny”: tytuł zapowiada sensację, a w treści pojawia się już konkretny przekaz o „prawdziwych sprawcach” czy „ukrytych planach elit”. Im więcej oburzonych wejść, tym silniejszy sygnał dla algorytmu, że materiał warto promować.

Formaty dopasowane do rytmu dnia

Ekstremistyczni influencerzy rzadko ograniczają się do jednego formatu. Budują pełne środowisko medialne, które wypełnia różne momenty dnia odbiorcy:

- krótkie klipy – na przerwy w pracy, do szybkiego „poczęstowania” się oburzeniem lub poczuciem wyższości,

- streamy na żywo – wieczorne „spotkania”, podczas których buduje się wspólnotę i omawia bieżące wydarzenia,

- podcasty lub długie nagrania – do słuchania w drodze, przy ćwiczeniach, jako „alternatywne radio”,

- newslettery i zamknięte grupy – do codziennej dawki „prawdziwych informacji”, które mają zastąpić tradycyjne media.

W efekcie cyfrowy agitator nie jest tylko jednym z wielu kanałów. Dla części odbiorców staje się głównym filtrem rzeczywistości, przez który przechodzi interpretacja większości wydarzeń dnia.

Jak ekstremiści „opakowują” przekaz: estetyka, język, narracje

Estetyka memów, glitchy i ironii

Współczesna propaganda ekstremistyczna rzadko przypomina plakaty z minionych dekad. Zamiast patosu dominuje ironia i estetyka memiczna. Przekaz jest rozmyty w żartach, przeróbkach, cytatach z popkultury. Oficjalnie – „to tylko mem”. Nieformalnie – nośnik bardzo konkretnych kodów tożsamościowych.

Na poziomie wizualnym widać kilka powtarzających się motywów:

- kolorystyka i symbole kojarzone z subkulturami (np. estetyka retrofuturystyczna, cyberpunk, militarne stylizacje),

- glitche, ziarno, celowe „zepsucie” obrazu – jako znak oddalenia od „gładkiego mainstreamu”,

- połączenia pozornie odległych światów – bohaterowie anime, gry wideo i memy polityczne w jednym kadrze.

Taka estetyka jest atrakcyjna dla młodszych odbiorców i dobrze pasuje do szybko konsumowanych treści. Jednocześnie pozwala ukryć przekaz pod warstwą żartu: krytyk „nie rozumie memów”, odbiorca czuje się wtajemniczony.

Język insiderski i kodowanie wrogości

Cyfrowi agitatorzy rzadko mówią wprost o konkretnych grupach w kategoriach, które łatwo zakwalifikować jako mowę nienawiści. Zamiast tego stosują język adresowany do wtajemniczonych:

- neologizmy i pseudonimy dla grup, instytucji, mediów,

- ironiczne określenia przeciwników, które w skrócie mieszczą całą opowieść o ich rzekomej głupocie czy złej woli,

- zastępniki pojęć – zamiast nazw narodowości, religii czy mniejszości używa się metafor i kodów, rozumianych wewnątrz społeczności.

Ta strategia utrudnia moderację i odpowiedzialność prawną (ciężko wskazać jednoznacznie dyskryminujący cytat), a jednocześnie wzmacnia poczucie bycia „częścią klubu”. Kto rozumie skróty i odniesienia, ten należy do „naszych”.

Narracje krzywdy, odkupienia i misji

W tle memów i żartów powtarza się kilka stabilnych opowieści. To one niosą ładunek radykalizujący, nawet jeśli pojedyncze treści wydają się tylko „opiniami”. Najczęściej powracają:

- narracja krzywdy – „nasza grupa jest ofiarą”, „wszyscy są przeciwko nam”, „nie wolno nam mówić prawdy”,

- narracja odkupienia – „byłeś naiwny, ale się obudziłeś”, „teraz widzisz, co się dzieje naprawdę”,

- narracja misji – „masz obowiązek otworzyć oczy innym”, „historia oceni twoją bierność”, „to ostatnia szansa, by się bronić”.

Do tego dochodzi narracja spisku: świat nie jest złożony, tylko ukryty. Skoro istnieje prosty plan „onych”, wystarczy równie prosty kontrplan „naszych”. Złożoność polityki, ekonomii, historii ustępuje miejsca klarownej opowieści o zdradzie i oporze.

Przykład z praktyki: seria filmów o „zdradzie elit” nie musi zawierać wprost treści ekstremistycznych. Jednak w komentarzach i na powiązanych kanałach pojawia się już wskazanie konkretnych „winnych” oraz wezwania do „rozprawienia się z nimi” – słownie lub fizycznie. Agitator może wówczas twierdzić, że to „tylko opinie widzów”.

Od „humoru ofensywnego” do normalizacji skrajności

Jednym z kluczowych mechanizmów jest przesuwanie granicy akceptowalnego dyskursu poprzez humor ofensywny. Najpierw pojawiają się żarty „na skraju”, celowane w mniejszości, kobiety, uchodźców, określone grupy religijne. Gdy reakcji sprzeciwu jest mało lub są wyśmiewane, kolejne treści idą krok dalej.

Cykl wygląda schematycznie:

- „To tylko żart, nie bądź przewrażliwiony”.

- „Skoro nie wolno się śmiać, to znaczy, że cenzura jest wszędzie”.

- „Skoro cenzura jest wszędzie, trzeba się jej przeciwstawić”.

- „Prawdziwi odważni ludzie mówią to, czego nie wolno mówić”.

Na końcu tego łańcucha może już stać otwarta nienawiść, przedstawiana jako „konsekwencja szczerości”. Krytycy są w tej logice nie tyle przeciwnikami poglądów, co częścią „systemu tłumienia prawdy”.

Mechanizmy wpływu: od sympatii do radykalizacji

Budowanie więzi paraspołecznej

Relacja między widzem a cyfrowym agitatorem często zaczyna się od pozornie banalnych elementów: wspólnych żartów, komentarzy o codzienności, narzekań na szkołę, pracę, politykę. Z czasem tworzy się więź paraspołeczna – jednostronna, ale emocjonalnie silna relacja, w której odbiorca traktuje twórcę jak znajomego lub kogoś z rodziny.

Praktyczne techniki to m.in.:

- bezpośrednie zwroty („słuchaj”, „wiem, że część z was przeżywa to samo”),

- odpowiadanie na komentarze i czytanie nicków na głos, co buduje wrażenie dwustronnego kontaktu,

- dzielenie się prywatnymi historiami – problemami finansowymi, konfliktami w rodzinie, wizytą u lekarza – które mają pokazać: „jestem taki jak ty”,

- pokazywanie kulis nagrań, domu, znajomych – by widz miał poczucie wejścia „za scenę”.

Na tym gruncie znacznie łatwiej przejść od rozmów o grach czy filmach do komentarzy o „prawdziwych wrogach” czy „zdradzie polityków”. Krytyka agitatiora zaczyna być odbierana nie jako spór o fakty, lecz jako atak na bliską osobę. Odbiorca wchodzi w rolę obrońcy.

Technika powolnego przesuwania granic

Radykalizacja rzadko odbywa się skokowo. Częściej to proces drobnych przesunięć, w którym kolejne treści są tylko trochę ostrzejsze niż poprzednie. Najpierw dominują uogólnione narzekania na „system” czy „elitę”, później pojawiają się precyzyjne wskazania grup „winnych wszystkiego”.

Między tymi etapami pojawiają się treści przejściowe: linki do „kontrowersyjnych raportów”, cytaty z bardziej skrajnych postaci, rekomendacje innych kanałów. Agitator często zastrzega: „nie ze wszystkim się zgadzam, ale warto posłuchać”, co obniża czujność. W efekcie widz przesuwa swoje granice akceptowalności, nie zauważając momentu, w którym normalizuje treści, które jeszcze kilka miesięcy wcześniej uznałby za skrajne.

Wzmacnianie przez społeczność i rytuały grupowe

Sam twórca to tylko część układanki. Drugi filar wpływu stanowi społeczność wokół kanału. Komentarze, czaty na żywo, grupy na komunikatorach pełnią funkcję rezonatora – radykalne opinie zyskują oklaski, wątpliwości są szybko ośmieszane lub uciszane. Działa tu prosta psychologia: nikt nie chce być jedyną osobą, która „psuje zabawę”.

Z czasem pojawiają się rytuały: stałe powitania na czacie, wewnętrzne żarty, wspólne akcje (np. „nalot” na profil krytycznego dziennikarza, masowe zgłaszanie nieprzychylnej strony). Takie praktyki zacieśniają więź i czynią z odbiorców nie tylko widzów, lecz także uczestników „misji”. Kto raz weźmie udział w akcji wymierzonej w wskazaną grupę, z większym prawdopodobieństwem zaakceptuje ostrzejsze formy wrogości.

Odzanieczulenie na przemoc i przyzwolenie

Ostatni etap to stopniowe odwrażliwianie na przemocową retorykę. Pojawiają się fantazje o „rozprawie”, „posprzątaniu kraju”, „nauczeniu ich rozumu”. Początkowo w formie żartów, memów, przesadzonych metafor. Z czasem część odbiorców zaczyna o tym mówić serio, co widać w komentarzach czy prywatnych grupach.

Cyfrowy agitator często nie formułuje bezpośrednich wezwań do przemocy. Wystarcza, że systematycznie dehumanizuje wskazaną grupę, nazywając ją „pasożytami”, „najeźdźcami”, „zdrajcami”. Jeśli ktoś z odbiorców przekroczy granicę i przejdzie do czynów, twórca może odciąć się od odpowiedzialności, twierdząc, że „nigdy do tego nie namawiał”. Formalnie ma rację; faktyczna rola w przygotowaniu gruntu bywa jednak trudna do zignorowania.

Cyfrowi agitatorzy nie działają w próżni. Wykorzystują logikę platform, estetykę popkultury i mechanizmy psychologiczne, by krok po kroku przesuwać normy tego, co „można powiedzieć” i „co wolno zrobić”. Tam, gdzie zwykły influencer sprzedaje produkty czy styl życia, oni sprzedają obraz świata z jasno wskazanymi wrogami – a wraz z nim gotowe scenariusze działania, których skutki coraz częściej widać poza ekranem.

Najczęściej zadawane pytania (FAQ)

Kim jest cyfrowy agitator i czym różni się od zwykłego influencera?

Cyfrowy agitator to influencer, który systematycznie wykorzystuje swoje zasięgi do promowania treści ekstremistycznych – politycznych, religijnych czy światopoglądowych. Zazwyczaj robi to w sposób rozłożony w czasie, częściowo zawoalowany, przeplatany rozrywką i „normalnymi” treściami. Ekstremizm staje się z początku dodatkiem, a później jednym z głównych wątków jego działalności.

Zwykły influencer może wyrażać ostre opinie, ale nie buduje całej narracji opartej na wskazywaniu jednej grupy jako wroga, dehumanizacji, wzywaniu do wykluczenia czy usprawiedliwianiu przemocy. Kluczowa jest funkcja przekazu: czy odbiorcy po kontakcie z twórcą stają się bardziej podatni na skrajne ideologie, czy nie.

Jak rozpoznać, że influencer przekracza granicę między opinią a ekstremistyczną agitacją?

Sygnalizatorów jest kilka i zwykle pojawiają się razem. Po pierwsze, stałe wyznaczanie jednego „wroga” – grupy etnicznej, politycznej, światopoglądowej – jako źródła wszelkiego zła. Po drugie, powtarzanie obraźliwych uogólnień i odczłowieczających określeń („szarańcza”, „pasożyty”, „podludzie”). Po trzecie, wprost lub pośrednio formułowane wezwania do izolowania, wyrzucania z życia publicznego, a czasem do przemocy.

Dobrym testem jest pytanie: jaki jest efekt? Jeśli po obejrzeniu materiałów rośnie akceptacja dla nienawiści, przemoc zaczyna się wydawać „zrozumiałą reakcją”, a organizacje radykalne są przedstawiane jako „jedyni, którzy mają odwagę działać” – mamy do czynienia raczej z agitacją niż z ostrą, ale mieszczącą się w granicach debaty opinią.

Na czym polega „miękka” normalizacja ekstremizmu przez influencerów?

„Miękka” normalizacja to wprowadzanie symboli, żartów i sloganów związanych z ekstremizmem do codziennych treści: vlogów, streamów, memów. Ekstremalne wątki nie są głównym tematem, funkcjonują raczej jak element scenografii – nadruk na koszulce, plakat w tle, ironiczny mem wyświetlany „dla beki”. Dzięki temu odbiorcy oswajają się z daną symboliką, zanim zrozumieją jej pochodzenie.

W praktyce wygląda to tak, że żarty uderzające w mniejszości czy „śmieszne” nawiązania do radykalnych ruchów zaczynają być traktowane jak zwykły humor. Gdy później ci sami odbiorcy trafią na jawną propagandę, nie odebrali jej jako czegoś całkowicie obcego – granice akceptowalności są już przesunięte.

Jakie są najczęstsze typy cyfrowych agitatorów w sieci?

Badacze opisują trzy szczególnie widoczne role. Pierwsza to lider opinii z wyraźną agendą: długie komentarze, podcasty, „analizy”, w których twórca stylizuje się na eksperta, demaskuje „ukryte mechanizmy” i krok po kroku prowadzi odbiorców w stronę radykalnej wizji świata.

Drugi typ to memiczny prowokator, czyli „śmieszek” bazujący na memach, krótkich klipach i zgryźliwym humorze. Formalnie „tylko żartuje”, ale stale utrwala obraz „wroga” – migranta, „zdrajcy narodu”, „degenerata”. Trzeci typ to „bohater antysystemu”, który buduje narrację o ciągłej cenzurze i prześladowaniu. Jego skrajne treści są przedstawiane jako odważne mówienie prawdy, a każda krytyka ma być dowodem na spisek systemu.

Czy każdy influencer szerzący radykalne treści robi to świadomie?

Nie zawsze. Z jednej strony są świadomi agitatorzy, którzy znają daną ideologię, mają powiązania z radykalnymi środowiskami, planują przekaz i kampanie. Z drugiej – tzw. „użyteczni idioci”: twórcy, którzy chwytają memy, slogany i symbole, bo „dobrze się klikają”, generują zasięgi i emocje, ale deklarują, że „to tylko prowokacja”.

Granica między tymi rolami przesuwa się wraz ze świadomością skutków. Jeśli ktoś po rzetelnych sygnałach o szkodliwości treści nie hamuje, lecz podbija stawkę, coraz częściej sięga po materiały z kręgów ekstremistycznych i otwarcie obraża krytyków, argument o „niewiedzy” staje się coraz mniej wiarygodny.

W jaki sposób organizacje ekstremistyczne współpracują z influencerami?

Formy współpracy są zróżnicowane. Czasem to luźne inspiracje i konsultacje: twórcy korzystają z materiałów propagandowych, cytują „analizy” radykalnych think tanków, udzielają się w zamkniętych czatach. Innym razem pojawia się pośrednie finansowanie – darowizny, sponsoring wydarzeń, promowanie zrzutek „na niezależne media”, które w praktyce wzmacniają infrastrukturę ruchu.

Najdalej idącą formą są skoordynowane kampanie: podobne treści u wielu influencerów w tym samym czasie, z powtarzającymi się hasłami i linkami, często zsynchronizowane z gorącymi wydarzeniami politycznymi. W takim modelu influencerzy stają się „frontową” warstwą komunikacji – przekładają ideologię na język memów, żartów i krótkich form wideo.

Dlaczego tak trudno zmierzyć skalę zjawiska cyfrowych agitatorów?

Problemem jest przede wszystkim środowisko, w którym działają. Najbardziej radykalne treści często krążą w zamkniętych grupach, prywatnych kanałach i na niszowych platformach reklamowanych jako „bez cenzury”. Do tego dochodzą formaty znikające – relacje na żywo bez zapisu, Stories, szyfrowane komunikatory – które utrudniają systematyczne archiwizowanie materiałów.

Cyfrowi agitatorzy aktywnie zaciemniają ślady: zmieniają nicki, zakładają nowe konta po blokadach, przenoszą część odbiorców między platformami. Co wiemy? Że zjawisko jest realne i dobrze udokumentowane na poziomie jakościowym. Czego nie wiemy? Dokładnej liczby takich twórców i zasięgu ich wpływu, bo infrastruktura sieci sprzyja rozproszeniu i szybkim migracjom treści.

Co warto zapamiętać

- Cyfrowy agitator to influencer, który stopniowo wplata treści ekstremistyczne w pozornie neutralne formaty (lifestyle, gry, komentarz społeczny), wykorzystując zaufanie i przywiązanie odbiorców do swojego wizerunku.

- Granica między wyrażaniem opinii a agitacją przebiega po funkcji przekazu: regularne wskazywanie „wroga”, dehumanizacja, nawoływanie do wykluczenia lub przemocy oraz usprawiedliwianie działań organizacji ekstremistycznych oznacza wejście w rolę propagandysty.

- Soft propaganda polega na normalizacji ekstremizmu „przy okazji” rozrywki – przez żarty, memy, symbole w tle czy gadżety; odbiorca oswaja się z radykalnymi treściami, zanim zorientuje się, co one faktycznie oznaczają.

- Cyfrowi agitatorzy przyjmują różne role: poważnego lidera opinii z „sekretną wiedzą”, memicznego prowokatora chowającego się za żartem oraz „bohatera antysystemu”, który każdą krytykę przedstawia jako dowód cenzury i spisku.

- Nie każdy twórca szerzący radykalne treści jest świadomym ideologiem – część działa jako „użyteczni idioci”, którzy podbijają kontrowersję dla zasięgów; sygnałem przejścia w świadomą agitację jest ignorowanie ostrzeżeń i coraz głębsze sięganie po materiały środowisk ekstremistycznych.

- Organizacje ekstremistyczne wykorzystują influencerów jako front propagandowy: dostarczają im narracje i symbole, wspierają finansowo (np. przez zrzutki na „niezależne media”) oraz koordynują kampanie tematyczne, zsynchronizowane z kalendarzem politycznym.